Лекция

Привет, сегодня поговорим про корреляция, обещаю рассказать все что знаю. Для того чтобы лучше понимать что такое корреляция , настоятельно рекомендую прочитать все из категории Теория вероятностей. Математическая статистика и Стохастический анализ .

Корреля́ция (от лат. correlatio — соотношение, взаимосвязь), корреляционная зависимость — статистическая взаимосвязь двух или нескольких случайных величин(либо величин, которые можно с некоторой допустимой степенью точности считать таковыми). При этом изменения значений одной или нескольких из этих величин сопутствуют систематическому изменению значений другой или других величин.[1] Математической мерой корреляции двух случайных величин служит корреляционное отношение  [2], либо коэффициент корреляции

[2], либо коэффициент корреляции  (или

(или  )[1]. В случае, если изменение одной случайной величины не ведет к закономерному изменению другой случайной величины, но приводит к изменению другой статистической характеристики данной случайной величины, то подобная связь не считается корреляционной, хотя и является статистической[3].

)[1]. В случае, если изменение одной случайной величины не ведет к закономерному изменению другой случайной величины, но приводит к изменению другой статистической характеристики данной случайной величины, то подобная связь не считается корреляционной, хотя и является статистической[3].

Впервые в научный оборот термин « корреляция » ввел французский палеонтолог Жорж Кювье в XVIII веке. Он разработал «закон корреляции» частей и органов живых существ, с помощью которого можно восстановить облик ископаемого животного, имея в распоряжении лишь часть его останков. В статистике слово «корреляция» первым стал использовать английский биолог и статистик Фрэнсис Гальтон в конце XIX века.[4]

Некоторые виды коэффициентов корреляции могут быть положительными или отрицательными. В первом случае предполагается, что мы можем определить только наличие или отсутствие связи, а во втором — также и ее направление. Если предполагается, что на значениях переменных задано отношение строгого порядка, тоотрицательная корреляция — корреляция, при которой увеличение одной переменной связано с уменьшением другой. При этом коэффициент корреляции будет отрицательным. Положительная корреляция в таких условиях — это такая связь, при которой увеличение одной переменной связано с увеличением другой переменной. Возможна также ситуация отсутствия статистической взаимосвязи — например, для независимых случайных величин.

Значительная корреляция между двумя случайными величинами всегда является свидетельством существования некоторой статистической связи в данной выборке, но эта связь не обязательно должна наблюдаться для другой выборки и иметь причинно-следственный характер. Часто заманчивая простота корреляционного исследования подталкивает исследователя делать ложные интуитивные выводы о наличии причинно-следственной связи между парами признаков, в то время как коэффициенты корреляции устанавливают лишь статистические взаимосвязи. Например, рассматривая пожары в конкретном городе, можно выявить весьма высокую корреляцию между ущербом, который нанес пожар, и количеством пожарных, участвовавших в ликвидации пожара, причем эта корреляция будет положительной. Из этого, однако, не следует вывод «увеличение количества пожарных приводит к увеличению причиненного ущерба», и тем более не будет успешной попытка минимизировать ущерб от пожаров путем ликвидации пожарных бригад.[5] В то же время , отсутствие корреляции между двумя величинами еще не значит, что между ними нет никакой связи. Например, зависимость может иметь сложный нелинейный характер , который корреляция не выявляет.

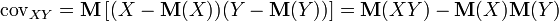

Важной характеристикой совместного распределения двух случайных величин является ковариация (или корреляционный момент). Ковариация является совместным центральным моментом второго порядка.[6] Ковариация определяется как математическое ожидание произведения отклонений случайных величин[7]:

,

,где  — математическое ожидание (в англоязычной литературе принято обозначение

— математическое ожидание (в англоязычной литературе принято обозначение  ).

).

Свойства ковариации:

и

и  равна нулю[8].

равна нулю[8].Так как  и

и  — независимые случайные величины , то и их отклонения

— независимые случайные величины , то и их отклонения  и

и  также независимы. Пользуясь тем, что математическое ожидание произведения независимых случайных величин равно произведению математических ожиданий сомножителей, а математическое ожидание отклонения равно нулю, имеем

также независимы. Пользуясь тем, что математическое ожидание произведения независимых случайных величин равно произведению математических ожиданий сомножителей, а математическое ожидание отклонения равно нулю, имеем

![\mathrm{cov}_{XY} = \mathbf{M} \left[(X - \mathbf{M}(X)) (Y - \mathbf{M}(Y))\right] = \mathbf{M}\ (X - \mathbf{M}(X)) \mathbf{M}(Y - \mathbf{M}(Y))=0.](/th/25/blogs/id4291/12_2e1554b8b8d0c679c1e95af2649d84d8.png)

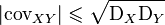

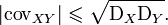

и

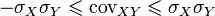

и  не превышает среднего геометрического их дисперсий:

не превышает среднего геометрического их дисперсий:  [9].

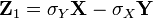

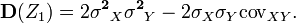

[9].Введем в рассмотрение случайную величину  (где

(где  — среднеквадратическое отклонение) и найдем ее дисперсию

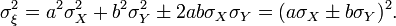

— среднеквадратическое отклонение) и найдем ее дисперсию  . Об этом говорит сайт https://intellect.icu . Выполнив выкладки получим:

. Об этом говорит сайт https://intellect.icu . Выполнив выкладки получим:

Любая дисперсия неотрицательна, поэтому

Отсюда

Введя случайную величину  , аналогично

, аналогично

Объединив полученные неравенства имеем

Или

Итак,

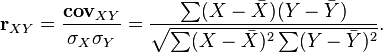

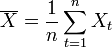

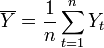

Для устранения недостатка ковариации был введен линейный коэффициент корреляции (или коэффициент корреляции Пирсона), который разработали Карл Пирсон, Фрэнсис Эджуорт и Рафаэль Уэлдон (англ.)русск. в 90-х годах XIX века. Коэффициент корреляции рассчитывается по формуле[10][8]:

где  ,

,  — среднее значение выборок.

— среднее значение выборок.

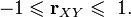

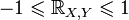

Коэффициент корреляции изменяется в пределах от минус единицы до плюс единицы[11].

Разделив обе части двойного неравенства  на

на  получим

получим

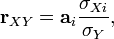

Линейный коэффициент корреляции связан с коэффициентом регрессии в виде следующей зависимости: где

где  — коэффициент регрессии,

— коэффициент регрессии,  — среднеквадратическое отклонение соответствующего факторного признака[12].

— среднеквадратическое отклонение соответствующего факторного признака[12].

Для графического представления подобной связи можно использовать прямоугольную систему координат с осями, которые соответствуют обеим переменным. Каждая пара значений маркируется при помощи определенного символа. Такой график называется «диаграммой рассеяния».

Метод вычисления коэффициента корреляции зависит от вида шкалы, к которой относятся переменные. Так, для измерения переменных с интервальной и количественной шкалами необходимо использовать коэффициент корреляции Пирсона (корреляция моментов произведений). Если по меньшей мере одна из двух переменных имеет порядковую шкалу, либо не является нормально распределенной, необходимо использовать ранговую корреляцию Спирмена или  ( тау ) Кендалла. В случае, когда одна из двух переменных является дихотомической, используется точечная двухрядная корреляция, а если обе переменные являются дихотомическими: четырехполевая корреляция. Расчет коэффициента корреляции между двумя недихотомическими переменными не лишен смысла только тогда, когда связь между ними линейна (однонаправлена).

( тау ) Кендалла. В случае, когда одна из двух переменных является дихотомической, используется точечная двухрядная корреляция, а если обе переменные являются дихотомическими: четырехполевая корреляция. Расчет коэффициента корреляции между двумя недихотомическими переменными не лишен смысла только тогда, когда связь между ними линейна (однонаправлена).

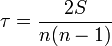

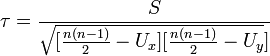

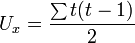

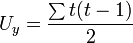

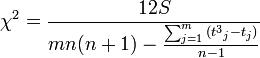

Применяется для выявления взаимосвязи между количественными или качественными показателями, если их можно ранжировать. Значения показателя X выставляют в порядке возрастания и присваивают им ранги. Ранжируют значения показателя Y и рассчитывают коэффициент корреляции Кендалла:

,

,

где  .

.

— суммарное число наблюдений, следующих за текущими наблюдениями с большим значением рангов Y.

— суммарное число наблюдений, следующих за текущими наблюдениями с большим значением рангов Y.

— суммарное число наблюдений, следующих за текущими наблюдениями с меньшим значением рангов Y. (равные ранги не учитываются!)

— суммарное число наблюдений, следующих за текущими наблюдениями с меньшим значением рангов Y. (равные ранги не учитываются!)

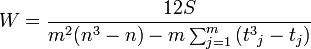

Если исследуемые данные повторяются (имеют одинаковые ранги), то в расчетах используется скорректированный коэффициент корреляции Кендалла:

— число связанных рангов в ряду X и Y соответственно.

— число связанных рангов в ряду X и Y соответственно.

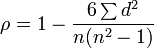

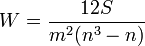

Степень зависимости двух случайных величин (признаков) X и Y может характеризоваться на основе анализа получаемых результатов  . Каждому показателю X и Y присваивается ранг. Ранги значений X расположены в естественном порядке i=1, 2, . . ., n. Ранг Y записывается как Ri и соответствует рангу той пары (X, Y), для которой ранг X равен i. На основе полученных рангов Х i и Yi рассчитываются их разности

. Каждому показателю X и Y присваивается ранг. Ранги значений X расположены в естественном порядке i=1, 2, . . ., n. Ранг Y записывается как Ri и соответствует рангу той пары (X, Y), для которой ранг X равен i. На основе полученных рангов Х i и Yi рассчитываются их разности  и вычисляется коэффициент корреляции Спирмена:

и вычисляется коэффициент корреляции Спирмена:

Значение коэффициента меняется от −1 (последовательности рангов полностью противоположны) до +1 (последовательности рангов полностью совпадают). Нулевое значение показывает, что признаки независимы.

Подсчитывается количество совпадений и несовпадений знаков отклонений значений показателей от их среднего значения.

C — число пар, у которых знаки отклонений значений от их средних совпадают.

H — число пар, у которых знаки отклонений значений от их средних не совпадают.

— число групп, которые ранжируются.

— число групп, которые ранжируются.

— число переменных.

— число переменных.

— ранг

— ранг  -фактора у

-фактора у  -единицы.

-единицы.

Значимость:

, то гипотеза об отсутствии связи отвергается.

, то гипотеза об отсутствии связи отвергается.

В случае наличия связанных рангов:

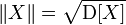

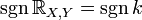

, то норма случайной величины будет равна

, то норма случайной величины будет равна  , и следствием неравенства Коши — Буняковского будет:

, и следствием неравенства Коши — Буняковского будет: .

. тогда и только тогда, когда

тогда и только тогда, когда  и

и  линейно зависимы (исключая события нулевой вероятности, когда несколько точек «выбиваются» из прямой, отражающей линейную зависимость случайных величин):

линейно зависимы (исключая события нулевой вероятности, когда несколько точек «выбиваются» из прямой, отражающей линейную зависимость случайных величин): ,

, . Более того в этом случае знаки

. Более того в этом случае знаки  и

и  совпадают:

совпадают: .

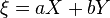

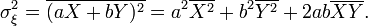

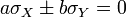

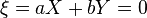

.Рассмотрим случайные величины X и Y c нулевыми средними, и дисперсиями, равными, соответственно,  и

и  . Подсчитаем дисперсию случайной величины

. Подсчитаем дисперсию случайной величины  :

:

Если предположить, что коэффициент корреляции

то предыдущее выражение перепишется в виде

Поскольку всегда можно выбрать числа a и b так, чтобы  (например, если

(например, если  , то берем произвольное a и

, то берем произвольное a и  ), то при этих a и b дисперсия

), то при этих a и b дисперсия  , и значит

, и значит  почти наверное. Но это и означает линейную зависимость между X и Y. Доказательство очевидным образом обобщается на случай величин X и Y с ненулевыми средними, только в вышеприведенных выкладках надо будет X заменить на

почти наверное. Но это и означает линейную зависимость между X и Y. Доказательство очевидным образом обобщается на случай величин X и Y с ненулевыми средними, только в вышеприведенных выкладках надо будет X заменить на  , и Y — на

, и Y — на  .

.

независимые случайные величины , то

независимые случайные величины , то  . Обратное в общем случае неверно.

. Обратное в общем случае неверно.Корреляционный анализ — метод обработки статистических данных, с помощью которого измеряется теснота связи между двумя или более переменными. Корреляционный анализ тесно связан с регрессионным анализом (также часто встречается термин « корреляционно- регрессионный анализ », который является более общим статистическим понятием), с его помощью определяют необходимость включения тех или иных факторов в уравнение множественной регрессии, а также оценивают полученное уравнение регрессии на соответствие выявленным связям (используя коэффициент детерминации).[1][2]

с соответствующими коэффициентами корреляций для каждого из них. Коэффициент корреляции отражает «зашумленность» линейной зависимости (верхняя строка), но не описывает наклон линейной зависимости (средняя строка), и совсем не подходит для описания сложных, нелинейных зависимостей (нижняя строка). Для распределения, показанного в центре рисунка, коэффициент корреляции не определен, так как дисперсия y равна нулю.

с соответствующими коэффициентами корреляций для каждого из них. Коэффициент корреляции отражает «зашумленность» линейной зависимости (верхняя строка), но не описывает наклон линейной зависимости (средняя строка), и совсем не подходит для описания сложных, нелинейных зависимостей (нижняя строка). Для распределения, показанного в центре рисунка, коэффициент корреляции не определен, так как дисперсия y равна нулю.Данный метод обработки статистических данных весьма популярен в экономике и социальных науках (в частности в психологии и социологии), хотя сфера применения коэффициентов корреляции обширна: контроль качества промышленной продукции, металловедение, агрохимия, гидробиология, биометрия и прочие. В различных прикладных отраслях приняты разные границы интервалов для оценки тесноты и значимости связи.

Популярность метода обусловлена двумя моментами: коэффициенты корреляции относительно просты в подсчете, их применение не требует специальной математической подготовки. В сочетании с простотой интерпретации, простота применения коэффициента привела к его широкому распространению в сфере анализа статистических данных.

Корреляция — взаимосвязь признаков (может быть положительной или отрицательной). Обусловлена сцеплением генов или плейотропией[15]

На этом все! Теперь вы знаете все про корреляция, Помните, что это теперь будет проще использовать на практике. Надеюсь, что теперь ты понял что такое корреляция и для чего все это нужно, а если не понял, или есть замечания, то не стесняйся, пиши или спрашивай в комментариях, с удовольствием отвечу. Для того чтобы глубже понять настоятельно рекомендую изучить всю информацию из категории Теория вероятностей. Математическая статистика и Стохастический анализ

Комментарии

Оставить комментарий

Теория вероятностей. Математическая статистика и Стохастический анализ

Термины: Теория вероятностей. Математическая статистика и Стохастический анализ