Лекция

Привет, сегодня поговорим про линейные регрессионные модели, обещаю рассказать все что знаю. Для того чтобы лучше понимать что такое линейные регрессионные модели , настоятельно рекомендую прочитать все из категории Моделирование и Моделирование систем.

В целях исследований часто бывает удобно представить исследуемый объект в виде ящика, имеющего входы и выходы, не рассматривая детально его внутренней структуры. Конечно, преобразования в ящике (на объекте) происходят (сигналы проходят по связям и элементам, меняют свою форму и т. п.), но при таком представлении они происходят скрыто от наблюдателя.

По степени информированности исследователя об объекте существует деление объектов на три типа «ящиков»:

Черный ящик условно изображают как на рис. 2.1.

|

|

| Рис. 2.1. Обозначение черного ящика на схемах |

Значения на входах и выходах черного ящика можно наблюдать и измерять. Содержимое ящика неизвестно.

Задача состоит в том, чтобы, зная множество значений на входах и выходах, построить модель, то есть определить функцию ящика, по которой вход преобразуется в выход. Такая задача называетсязадачей регрессионного анализа.

В зависимости от того, доступны входы исследователю для управления или только для наблюдения, можно говорить про активный или пассивный эксперимент с ящиком.

Пусть, например, перед нами стоит задача определить, как зависит выпуск продукции от количества потребляемой электроэнергии. Результаты наблюдений отобразим на графике (см.рис. 2.2). Всего на графике n экспериментальных точек, которые соответствуют n наблюдениям.

|

|

| Рис. 2.2. Графический вид представления результатов наблюдения над черным ящиком |

Для начала предположим, что мы имеем дело с черным ящиком, имеющим один вход и один выход. Допустим для простоты, что зависимость между входом и выходом линейная или почти линейная. Тогда данная модель будет называться линейной одномерной регрессионной моделью.

1) Исследователь вносит гипотезу о структуре ящика

Рассматривая экспериментально полученные данные, предположим, что они подчиняются линейной гипотезе, то есть выход Y зависит от входа X линейно, то есть гипотеза имеет вид:Y = A1X + A0 (рис. 2.2).

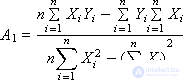

2) Определение неизвестных коэффициентов A0 и A1 модели

Линейная одномерная модель (рис. 2.3).

|

|

| Рис. 2.3. Одномерная модель черного ящика |

Для каждой из n снятых экспериментально точек вычислим ошибку (Ei) между экспериментальным значением (YiЭксп.) и теоретическим значением (YiТеор.), лежащим на гипотетической прямой A1X + A0 (см. рис. 2.2):

Ei = (YiЭксп. – YiТеор.), i = 1, …, n;

Ei = Yi – A0 – A1 · Xi, i = 1, …, n.

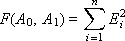

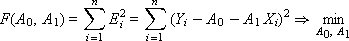

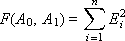

Ошибки Ei для всех n точек следует сложить. Чтобы положительные ошибки не компенсировали в сумме отрицательные, каждую из ошибок возводят в квадрат и складывают их значения в суммарную ошибку F уже одного знака:

Ei2 = (Yi – A0 – A1 · Xi)2, i = 1, …, n.

Цель метода — минимизация суммарной ошибки F за счет подбора коэффициентов A0, A1. Об этом говорит сайт https://intellect.icu . Другими словами, это означает, что необходимо найти такие коэффициенты A0, A1 линейной функцииY = A1X + A0, чтобы ее график проходил как можно ближе одновременно ко всем экспериментальным точкам. Поэтому данный метод называется методом наименьших квадратов.

Суммарная ошибка F является функцией двух переменных A0 и A1, то есть F(A0, A1), меняя которые, можно влиять на величину суммарной ошибки (см. рис. 2.4).

|

|

| Рис. 2.4. Примерный вид функции ошибки |

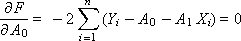

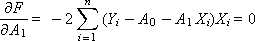

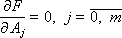

Чтобы суммарную ошибку минимизировать, найдем частные производные от функции F по каждой переменной и приравняем их к нулю (условие экстремума):

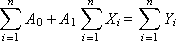

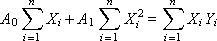

После раскрытия скобок получим систему из двух линейных уравнений:

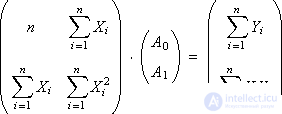

Для нахождения коэффициентов A0 и A1 методом Крамера представим систему в матричной форме:

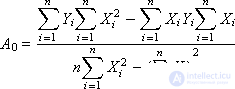

Решение имеет вид:

Вычисляем значения A0 и A1.

3) Проверка

Чтобы определить, принимается гипотеза или нет, нужно, во-первых, рассчитать ошибку между точками заданной экспериментальной и полученной теоретической зависимости и суммарную ошибку:

Ei = (YiЭксп. – YiТеор.), i = 1, …, n

И, во-вторых, необходимо найти значение σ по формуле  , где F — суммарная ошибка, n — общее число экспериментальных точек.

, где F — суммарная ошибка, n — общее число экспериментальных точек.

Если в полосу, ограниченную линиями YТеор. – S и YТеор. + S (рис. 2.5), попадает 68.26% и более экспериментальных точек YiЭксп., то выдвинутая нами гипотеза принимается. В противном случае выбирают более сложную гипотезу или проверяют исходные данные. Если требуется большая уверенность в результате, то используют дополнительное условие: в полосу, ограниченную линиямиYТеор. – 2S и YТеор. + 2S, должны попасть 95.44% и более экспериментальных точек YiЭксп..

|

|

| Рис. 2.5. Исследование допустимости принятия гипотезы |

Расстояние S связано с σ следующим соотношением:

S = σ/sin(β) = σ/sin(90° – arctg(A1)) = σ/cos(arctg(A1)),

что проиллюстрировано на рис. 2.6.

|

|

| Рис. 2.6. Связь значений σ и S |

Условие принятия гипотезы выведено из нормального закона распределения случайных ошибок (см. рис. 2.7). P — вероятность распределения нормальной ошибки.

|

|

| Рис. 2.7. Иллюстрация закона нормального распределения ошибок |

Наконец, приведем на рис. 2.8 графическую схему реализации одномерной линейной регрессионной модели.

|

|

| Рис. 2.8. Схема реализации метода наименьших квадратов в среде моделирования |

Практика № 01: «Регрессионные модели»

Лабораторная работа № 01: « линейные регрессионные модели »

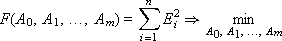

Предположим, что функциональная структура ящика снова имеет линейную зависимость, но количество входных сигналов, действующих одновременно на объект, равно m (см. рис. 2.9):

Y = A0 + A1 · X1 + … + Am · Xm.

|

|

| Рис. 2.9. Обозначение многомерного черного ящика на схемах |

Так как подразумевается, что мы имеем экспериментальные данные о всех входах и выходах черного ящика, то можно вычислить ошибку между экспериментальным (YiЭксп.) и теоретическим (YiТеор.) значением Y для каждой i-ой точки (пусть, как и прежде, число экспериментальных точек равно n):

Ei = (YiЭксп. – YiТеор.), i = 1, …, n;

Ei = Yi – A0 – A1 · X1i – … – Am · Xmi, i = 1, …, n.

Минимизируем суммарную ошибку F:

Ошибка F зависит от выбора параметров A0, A1, …, Am. Для нахождения экстремума приравняем все частные производные F по неизвестным A0, A1, …, Am к нулю:

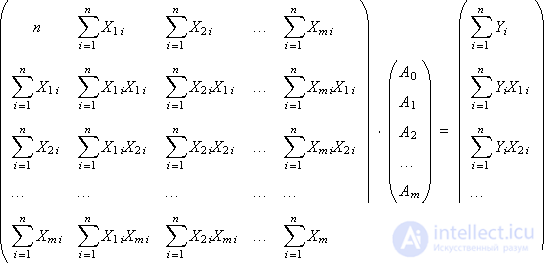

Получим систему из m + 1 уравнения с m + 1 неизвестными, которую следует решить, чтобы определить коэффициенты линейной множественной модели A0, A1, …, Am. Для нахождения коэффициентов методом Крамера представим систему в матричном виде:

Вычисляем коэффициенты A0, A1, …, Am.

Далее, по аналогии с одномерной моделью (см. 3). «Проверка»), для каждой точки вычисляется ошибка Ei; затем находится суммарная ошибка F и значения σ и S с целью определить, принимается ли выдвинутая гипотеза о линейности многомерного черного ящика или нет.

При помощи подстановок и переобозначений к линейной множественной модели приводятся многие нелинейные модели. Подробно об этом рассказывается в материале следующей лекции.

Надеюсь, эта статья об увлекательном мире линейные регрессионные модели, была вам интересна и не так сложна для восприятия как могло показаться. Желаю вам бесконечной удачи в ваших начинаниях, будьте свободными от ограничений восприятия и позвольте себе делать больше активности в изученном направлени . Надеюсь, что теперь ты понял что такое линейные регрессионные модели и для чего все это нужно, а если не понял, или есть замечания, то не стесняйся, пиши или спрашивай в комментариях, с удовольствием отвечу. Для того чтобы глубже понять настоятельно рекомендую изучить всю информацию из категории Моделирование и Моделирование систем

Из статьи мы узнали кратко, но содержательно про линейные регрессионные модели

Комментарии

Оставить комментарий

Моделирование и Моделирование систем

Термины: Моделирование и Моделирование систем