Лекция

Привет, сегодня поговорим про модель хопфилда, обещаю рассказать все что знаю. Для того чтобы лучше понимать что такое модель хопфилда , настоятельно рекомендую прочитать все из категории Computational Neuroscience (вычислительная нейронаука) Теория и приложения искусственных нейронных сетей.

Конфигурация и устойчивость сетей с обратными связями. модель хопфилда . Правило обучения Хебба. Ассоциативная память. Распознавание образов.

Модель Хопфилда (J.J.Hopfield, 1982) занимает особое место в ряду нейросетевых моделей. В ней впервые удалось установить связь между нелинейными динамическими системами и нейронными сетями. Образы памяти сети соответствуют устойчивым предельным точкам (аттракторам) динамической системы. Особенно важной оказалась возможность переноса математического аппарата теории нелинейных динамических систем (и статистической физики вообще) на нейронные сети. При этом появилась возможность теоретически оценить об'ем памяти сети Хопфилда, определить область параметров сети, в которой достигается наилучшее функционирование.

В этой лекции мы последовательно начнем рассмотрение с общих свойств сетей с обратными связями, установим правило обучения для сети Хопфилда (правило Хебба), и затем перейдем к обсуждению ассоциативных свойств памяти этой нейронной сети при решении задачи распознавания образов.

Рассмотренный нами ранее ПЕРСЕПТРОН относится к классу сетей с направленным потоком распространения информации и не содержит обратных связей. На этапе функционирования каждый нейрон выполняет свою функцию - передачу возбуждения другим нейронам - ровно один раз. Динамика состояний нейронов является безитерационной.

Несколько более сложной является динамика в сети Кохонена. Конкурентное соревнование нейронов достигается путем итераций, в процессе которых информация многократно передается между нейронами.

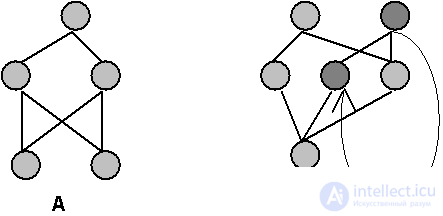

В общем случае может быть рассмотрена нейронная сеть (см. Рис. 8.1), содержащая произвольные обратные связи, по которым переданное возбуждение возвращается к данному нейрону, и он повторно выполняет свою функцию. Наблюдения за биологическими локальными нейросетями указывают на наличие множественных обратных связей. Нейродинамика в таких системах становится итерационной. Это свойство существенно расширяет множество типов нейросетевых архитектур, но одновременно приводит к появлению новых проблем.

Безитерационная динамика состояний нейронов является, очевидно, всегда устойчивой. Обратные связи могут приводить к возникновению неустойчивостей, подобно тем, которые возникают в усилительных радитехнических системах при положительной обратной связи. В нейронных сетях неустойчивость проявляется в блуждающей смене состояний нейронов, не приводящей к возникновению стационарных состояний. В общем случае ответ на вопрос об устойчивости динамики произвольной системы с обратными связями крайне сложен и до настоящего времени является открытым.

Ниже мы остановимся на важном частном случае нейросетевой архитектуры, для которой свойства устойчивости подробно исследованы.

Рассмотрим сеть из N формальных нейронов, в которой степень возбуждения каждого из нейронов Si, i=1..N, может принимать только два значения {-1, +1}. Любой нейрон имеет связь со всеми остальными нейронами Sj, которые в свою очередь связаны с ним. Силу связи от i-го к j-му нейрону обозначим как Wij.

В модели Хопфилда предполагается условие симметричности связей Wij=Wji, с нулевыми диагональными элементами Wii=0. К сожалению, это условие имеет весьма отдаленное отношение к известным свойствам биологических сетей, в которых, наоборот, если один нейрон передает возбуждение другому, то тот, в большинстве случаев, непосредственно не связан с первым. Однако именно симметричность связей, как будет ясно из дальнейшего, существенно влияет на устойчивость динамики.

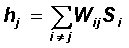

Изменение состояния каждого нейрона Sj в модели Хопфилда происходит по известному правилу для формальных нейронов МакКаллока и Питтса. Поступающие на его входы сигналы Si в момент t взвешиваются с весами матрицы связей Wij и суммируются, определяя полный уровень силы входного сигнала:

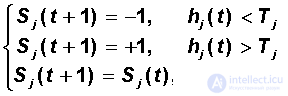

Далее в момент t+1 нейрон изменяет состояние своего возбуждения в зависимости от уровня сигнала h и индивидуального порога каждого нейрона T:

Изменение состояний возбуждения всех нейронов может происходить одновременно, в этом случае говорят о параллельной динамике. Рассматривается также и последовательнаянейродинамика, при которой в данный момент времени происходит изменение состояния только одного нейрона. Многочисленные исследования показали, что свойства памяти нейронной сети практически не зависят от типа динамики. При моделировании нейросети на обычном компьютере удобнее последовательная смена состояний нейронов. В аппаратных реализациях нейросетей Хопфилда применятся параллельная динамика.

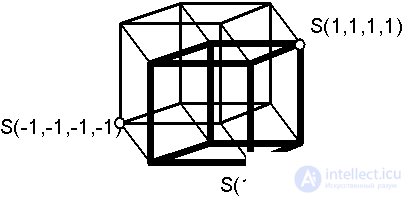

Совокупность значений возбуждения всех нейронов Si в некоторый момент времени образует вектор состояния Sсети. Нейродинамика приводит к изменению вектора состоянияS(t). Вектор состояния описывает траекторию в пространстве состояний нейросети. Об этом говорит сайт https://intellect.icu . Это пространство для сети с двумя уровнями возбуждения каждого нейрона, очевидно, представляет собой множество вершин гиперкуба размерности, равной числу нейронов N. Возможные наборы значений координат вершин гиперкуба (см. Рис.8.2) и определяют возможные значения вектора состояния.

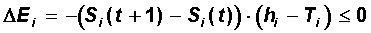

Рассмотрим теперь проблему устойчивости динамики изменения состояний. Поскольку на каждом временном шаге некоторый нейрон i изменяет свое состояние в соответствии со знаком величины (hi - Ti), то приведенное ниже соотношение всегда неположительно:

Таким образом, оответствующая величина E, являющаяся суммой отдельных значений Ei, может только убывать, либо сохранять свое значение в процессе нейродинамики.

Введенная таким образом величина E является функцией состояния E=E(S) и называется энергетической функцией (энергией) нейронной сети Хопфилда. Поскольку она обладает свойством невозрастания при динамике сети, то одновременно является для нее функцией Ляпунова (А.М. Ляпунов, 1892). Поведение такой динамической системы устойчиво при любом исходном векторе состояния S(t=0) и при любой симметричной матрице связей W с нулевыми диагональными элементами. Динамика при этом заканчивается в одном из минимумов функции Ляпунова, причем активности всех нейронов будут совпадать по знаку с входными сигналами h.

Поверхность энергии E(S) в пространстве состояний имеет весьма сложную форму с большим количеством локальных минимумов, образно напоминая стеганое одеяло. Стационарные состояния, отвечающие минимумам, могут интерпретироваться, как образы памяти нейронной сети. Эволюция к такому образу соотвествует процессу извлечения из памяти. При произвольной матрице связей W образы также произвольны. Для записи в память сети какой-либо осмысленной информации требуется определенное значение весов W, которое может получаться в процессе обучения.

Правило обучения для сети Хопфилда опирается на исследования Дональда Хебба (D.Hebb, 1949), который предположил, что синаптическая связь, соединяющая два нейрона будет усиливатьося, если в процессе обучения оба нейрона согласованно испытывают возбуждение либо торможение. Простой алгоритм, реализующий такой механизм обучения, получил название правила Хебба. Рассмотрим его подробно.

Пусть задана обучающая выборка образов x a, a = 1..p. Требуется построить процесс получения матрицы связей W, такой, что соответствующая нейронная сеть будет иметь в качестве стационарных состояний образы обучающей выборки (значения порогов нейронов T обычно полагаются равными нулю).

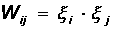

В случае одного обучающего образа правило Хебба приводит к требуемой матрице:

Покажем, что состояние S=x является стационарным для сети Хопфилда с указанной матрицей. Действительно, для любой пары нейронов i и j энергия их взаимодействия в состоянии x достигает своего минимально возможного значения Eij = -(1/2) x i x j x i x j = -1/2.

При этом Е -полная энергия равна E = -(1/2) N 2, что отвечает глобальному минимуму.

Для запоминания других образов может применяется итерационный процесс:

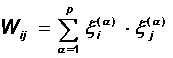

который приводит к полной матрице связей в форме Хебба:

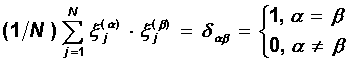

Устойчивость совокупности образов не столь очевидна, как в случае одного образа. Ряд исследований показывает, что нейронная сеть, обученная по правилу Хебба, может в среднем, при больших размерах сети N, хранить не более чем p » 0.14 N различных образов. Устойчивость может быть показана для совокупности ортогональных образов, когда

В этом случае для каждого состояния x a произведение суммарного входа i-го нейрона hi на величину его активности Si = x ai оказывается положительным, следовательно само состояние xa является состоянием притяжения (устойчивым аттрактором):

Таким образом, правило Хебба обеспечивает устойчивость сети Хопфилда на заданном наборе относительно небольшого числа ортогональных образов. В следующем пункте мы остановимся на особенностях памяти полученной нейронной сети.

Динамический процесс последовательной смены состояний нейронной сети Хопфилда завершается в некотором стационарном состоянии, являющемся локальным минимумом энергетической функции E(S). Невозрастание энергии в процессе динамики приводит к выбору такого локального минимума S, в бассейн притяжения которого попадает начальное состояние (исходный, пред'являемый сети образ) S0. В этом случае также говорят, что состояние S0 находится в чаше минимума S.

При последовательной динамике в качестве стационарного состояния будет выбран такой образ S, который потребует минимального числа изменений состояний отдельных нейронов. Поскольку для двух двоичных векторов минимальное число изменений компонент, переводящее один вектор в другой, является расстоянием Хемминга r H(S,S0), то можно заключить, что динамика сети заканчивается в ближайшем по Хеммингу локальном минимуме энергии.

Пусть состояние S соответствует некоторому идеальному образу памяти. Тогда эволюцию от состояния S0 к состоянию S можно сравнить с процедурой постепенного восстановления идеального образа S по его искаженной (зашумленной или неполной) копии S0. Память с такими свойствами процесса считывания информации являетсяассоциативной. При поиске искаженные части целого восстанавливаются по имеющимся неискаженным частям на основе ассоциативных связей между ними.

Ассоциативный характер памяти сети Хопфилда качественно отличает ее от обычной, адресной, компьютерной памяти. В последней извлечение необходимой информации происходит по адресу ее начальной точки (ячейки памяти). Потеря адреса (или даже отного бита адреса) приводит к потере доступа ко всему информационному фрагменту. При использовании ассоциативной памяти доступ к информации производится непосредственно по ее содержанию, т.е. по частично известным искаженным фрагментам. Потеря части информации или ее информационное зашумление не приводит к катастрофическому ограничению доступа, если оставшейся информации достаточно для извлечения идеального образа.

Поиск идеального образа по имеющейся неполной или зашумленной его версии называется задачей распознавания образов. В нашей лекции особенности решения этой задачи нейронной сетью Хопфилда будут продемонстрированы на примерах, которые получены с использованием модели сети на персональной ЭВМ.

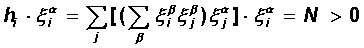

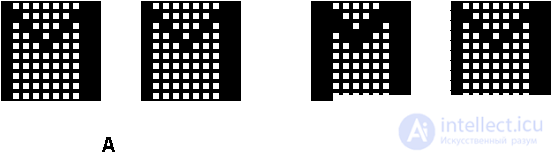

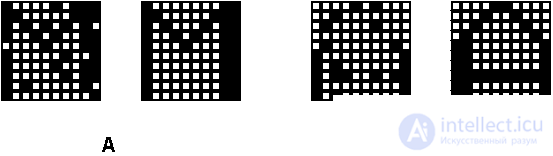

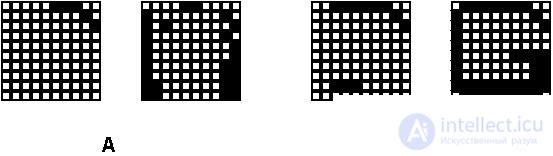

В рассматриваемой модели сеть содержала 100 нейронов, упорядоченных в матрицу 10 x 10. Сеть обучалась по правилу Хебба на трех идеальных образах - шрифтовых начертаниях латинских букв M, A и G (Рис. 8.3.). После обучения нейросети в качестве начальных состояний нейронов пред'являлись различные искаженные версии образов, которые в дальнейшем эволюционировали с последовательной динамикой к стационарным состояниям.

Для каждой пары изображений на рисунках этой страницы, левый образ является начальным состоянием, а правый - результатом работы сети - достигнутым стационарным состоянием.

Образ на Рис. 8.4.(А) был выбран для тестирования адекватности поведения на идеальной задаче, когда пред'явленное изображение точно соотвествует информации в памяти. В этом случае за один шаг было достигнуто стационарное состояние. Образ на Рис. 8.4.(Б) характерен для задач распознавания текста независимо от типа шрифта. Начальное и конечное изображения безусловно похожи, но попробуйте это об'яснить машине!

Задания на Рис. 8.5 характерны для практических приложений. Нейросетевая система способна распознавать практически полностью зашумленные образы. Задачи, соответствующие Рис. 8.6. и 8.7.(Б), демонстрируют замечательное свойство сети Хопфилда ассоциативно узнавать образ по его небольшому фрагменту. Важнейшей особенностью работы сети является генерация ложных образов. Пример релаксации к ложному образу показан на Рис. 8.7.(А). Ложный образ является устойчивым локальным экстремумом энергии, но не соответствует никакому идеальному образу. Он является в некотором смысле собирательным образом, наследующим черты идеальных собратьев. Ситуация с ложным образом эквивалентна нашему "Где-то я уже это видел".

В данной простейшей задаче ложный образ является "неверным" решением, и поэтому вреден. Однако, можно надеяться, что такая склонность сети к обобщениям наверняка может быть использована. Характерно, что при увеличении об'ема полезной информации (сравните Рис. 8.7.(А) и (Б)), исходное состояние попадает в область притяжения требуемого стационарного состояния, и образ распознается.

Несмотря на интересные качества, нейронная сеть в классической модели Хопфилда далека от совершенства. Она обладает относительно скромным об'емом памяти, пропорциональным числу нейронов сети N, в то время как системы адресной памяти могут хранить до 2N различных образов, используя N битов. Кроме того, нейронные сети Хопфилда не могут решить задачу распознавания, если изображение смещено или повернуто относительно его исходного запомненного состояния. Эти и другие недостатки сегодня определяют общее отношение к модели Хопфилда, скорее как к теоретическому построению, удобному для исследований, чем как повседневно используемому практическому средству.

На следующих лекциях мы рассмотрим развитие модели Хопфилда, модификации правила Хебба, увеличивающие об'ем памяти, а также приложения вероятностных обобщений модели Хопфилда к задачам комбинаторной оптимизации.

В общем, мой друг ты одолел чтение этой статьи об модель хопфилда. Работы впереди у тебя будет много. Смело пиши комментарии, развивайся и счастье окажется в твоих руках. Надеюсь, что теперь ты понял что такое модель хопфилда и для чего все это нужно, а если не понял, или есть замечания, то не стесняйся, пиши или спрашивай в комментариях, с удовольствием отвечу. Для того чтобы глубже понять настоятельно рекомендую изучить всю информацию из категории Computational Neuroscience (вычислительная нейронаука) Теория и приложения искусственных нейронных сетей

Комментарии

Оставить комментарий

Computational Neuroscience (вычислительная нейронаука) Теория и приложения искусственных нейронных сетей

Термины: Computational Neuroscience (вычислительная нейронаука) Теория и приложения искусственных нейронных сетей