Лекция

Развитие современных систем искусственного интеллекта (ИИ) сопровождается стремительным ростом требований к вычислительным ресурсам. Нейросетевые модели стали в десятки и сотни раз больше по числу параметров, а их обучение и эксплуатация требуют существенных затрат электрической энергии. Понимание структуры энергопотребления ИИ позволяет оценить экологический след технологий, оптимизировать инфраструктуру и прогнозировать дальнейшее развитие отрасли.

Энергозатраты делятся на две основные категории:

Обучение больших моделей — самый энергоемкий этап жизненного цикла ИИ. Оно включает:

многократное прохождение обучающих данных через модель (эпохи);

работу десятков или сотен графических ускорителей;

передачу данных между узлами кластера;

охлаждение серверов.

Например:

обучение больших языковых моделей десятков миллиардов параметров может потребовать от нескольких гигаватт-часов до десятков гигаватт-часов энергии;

крупный кластер GPU потребляет 3–15 МВт в зависимости от размера и загрузки.

Для обучения самых больших моделей необходима существенная инфраструктура. Тенденция к увеличению размеров моделей видна в списке крупных языковых моделей . Например, обучение GPT-2 (то есть модели с 1,5 миллиардами параметров) в 2019 году обошлось в 50 000 долларов, в то время как обучение PaLM ( то есть модели с 540 миллиардами параметров) в 2022 году стоило 8 миллионов долларов, а Megatron-Turing NLG 530B (в 2021 году) — около 11 миллионов долларов. Определение «большая» в выражении «большая языковая модель» по своей сути расплывчато, поскольку нет определенного порогового значения для количества параметров, необходимых для того, чтобы модель считалась «большой».

Использование модели — ответы на запросы, генерация изображений, аудио и т.д. — также требует существенных ресурсов, особенно при массовых обращениях.

Характерные цифры:

один запрос к модели масштаба GPT может потреблять от 0.1 до 2 Вт·с, а генерация длинного текста — в десятки раз больше;

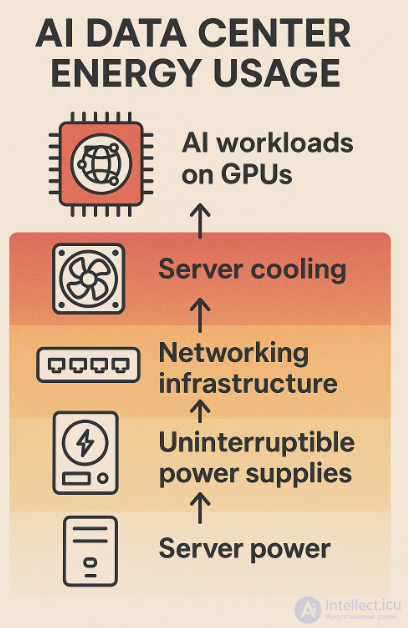

постоянная работа дата-центров включает затраты на:

питание серверов,

охлаждение,

сетевую инфраструктуру,

системы бесперебойного питания.

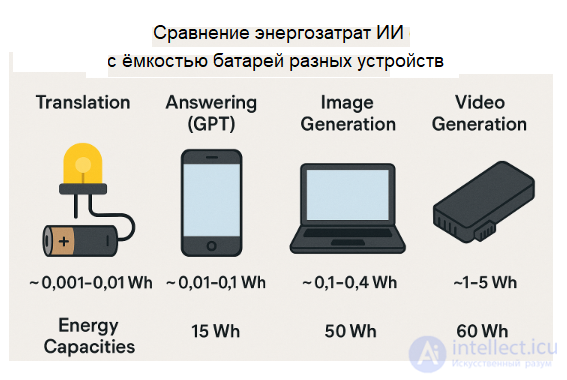

Ниже представлена сравнительная таблица по энергозатратам различных задач ИИ — от перевода текста до генерации изображений и видео. Она основана на свежих исследованиях MIT Technology Review, Nature и академических публикациях.

Таблица энергозатрат ИИ-систем

Данные ориентировочные, т.к. точные значения зависят от модели, дата-центра, GPU и оптимизаций.

| Тип задачи | Пример моделей | Описание нагрузки | Средний расход энергии за 1 запрос* | Комментарии |

|---|---|---|---|---|

| Классический машинный перевод (NMT) | Marian, OpusMT, mBART-small | Легкие seq2seq-модели, короткий контекст | 0.001–0.01 Wh | Очень низкая стоимость — модель маленькая, запросы короткие |

| Перевод или краткий ответ в чат-моделях (LLM small) | GPT-3.5-tier, Llama-3 8B | Малые LLM, короткий запрос | 0.02–0.1 Wh | Зависит от длины контекста; быстрые и дешевые модели |

| Ответы в больших LLM (GPT-4/5-class) | GPT-4, GPT-5, Claude-Opus | Большие трансформеры, длинный контекст | 0.3–3 Wh | Основной потребитель энергии — количество параметров и длина ответа |

| Длинные рассуждения (chain-of-thought) | GPT-5, DeepSeek-R1 | Очень большие LLM, много внутренних шагов | 1–10 Wh | Внутренние вычисления увеличивают энергозатраты ×3–10 |

| Генерация изображений (Diffusion) | Stable Diffusion, DALL·E, Midjourney | Итеративные денойзинг-процессы | 1–5 Wh за одно изображение | Зависит от числа шагов (50–150) и разрешения |

| Генерация 3D / depth / segmentation | ControlNet, SD-XL Depth | Доп. сети + diffusion | 2–7 Wh | Несколько моделей работают одновременно |

| Генерация короткого видео (1–5 сек) | Runway Gen-2, Sora-like | Diffusion + video transformer | 10–80 Wh | Самый энергоемкий тип генерации, пропорционален количеству кадров |

| Генерация длинного видео (10–60 сек) | Sora-class | Мульти-кадровые модели с огромным числом параметров | 150–600 Wh | Сильно зависит от FPS, разрешения и семплов |

| Рендеринг + симуляции ИИ (физика, агенты) | Google Imagen Video, Game-AI transformers | Комплексные вычисления + память | 5–20 Wh | Тяжелая многокомпонентная нагрузка |

* Wh = ватт-час.

Для ориентира: 1 Wh ≈ энергия, потребляемая лампочкой 1 Вт за 1 час.

5000 мА·ч при 3.85 В → ≈ 19.25 Вт·ч

4000 мА·ч при 3.7 В → ≈ 14.8 Вт·ч

3000 мА·ч при 3.7 В → ≈ 11.1 Вт·ч

Перевод текста — самая энергоэффективная задача, так как модели компактные и оптимизированные.

Ответы чат-ботов (GPT) — энергозатраты выше, особенно у больших моделей (GPT‑4).

Генерация изображений — требует значительно больше энергии, особенно при высоком разрешении.

Генерация видео — лидер по энергопотреблению, так как каждый кадр создается отдельно и требует больших вычислительных ресурсов.

Современные графические процессоры — основной рабочий инструмент ИИ:

потребляют 300–700 Вт каждый в режиме полной загрузки;

сервер из 8–16 GPU может потреблять до 10 кВт только на вычисления.

Google TPU, NVIDIA Grace Hopper, Cerebras и другие ускорители позволяют:

увеличить энергоэффективность операций;

сократить время обучения;

уменьшить тепловыделение.

Показатель PUE (Power Usage Effectiveness):

1.0 — идеал (вся энергия — только на вычисления),

дата-центры топ-класса работают на уровне PUE 1.1–1.2,

старые — 1.5–2.0.

Это означает, что на каждый киловатт работы оборудования может уходить еще 0.1–1 кВт только на охлаждение.

Размер модели — больше параметров: больше энергии.

Тип архитектуры — трансформеры энергоемкие; модели-эксперты (MoE) экономичнее.

Оптимизация вычислений — int8, int4, sparsity сокращают затраты.

Качество кода и параллелизации — отложенные градиенты, распределенное обучение.

Топология дата-центра — близость GPU, скорость интерконнектов.

Место расположения — холодные регионы позволяют снижать расходы на охлаждение.

Большие модели сопоставимы по энергопотреблению с:

авиационными перелетами,

работой крупных промышленных предприятий,

дата-центрами мировых соцсетей.

При этом энергетический след зависит не только от количества потребленной энергии, но и от ее источника:

угольная энергетика → высокий выброс CO₂,

возобновляемая → минимальное воздействие.

Многие компании переводят ИИ-серверы на солнечную, ветровую и геотермальную энергию.

Mixture of Experts (MoE) — активируют лишь часть параметров.

Компактные модели (small/efficient AI).

Тонкая настройка (fine-tuning) вместо полного обучения.

квантование (int8, int4);

sparsity (обнуление бесполезных весов);

компиляторы AI-графов: TensorRT, XLA, DeepSpeed.

энергоэффективные GPU нового поколения;

жидкостное охлаждение;

специализированные ускорители.

оптимизация размещения оборудования;

использование природного холода (Скандинавия, Канада);

переработка тепла в отопление зданий.

Рост спроса: к 2030 году системы ИИ могут потреблять до 3–5% мировой электроэнергии.

Новые парадигмы обучения:

обучение на симулированных данных,

бионические вычисления,

нейроморфные чипы.

Оптимизация алгоритмов станет ключевой задачей обучения моделей миллиардов параметров.

Децентрализованный ИИ: перенос инференса на мобильные устройства снизит нагрузку на дата-центры.

Государственные регуляции: нормы эффективности, лимиты выбросов, требования прозрачности.

Энергопотребление — центральная проблема современного ИИ. Рост вычислительных моделей приводит к заметному увеличению энергозатрат, однако прогресс в аппаратуре, алгоритмах и архитектуре дата-центров позволяет постепенно снижать удельную стоимость вычислений. Будущее ИИ зависит от способности отрасли найти баланс между производительностью, эффективностью и экологической ответственностью.

Комментарии

Оставить комментарий

Искусственный интеллект. Основы и история. Цели.

Термины: Искусственный интеллект. Основы и история. Цели.