Лекция

Привет, Вы узнаете о том , что такое вычисления на искусственных нейронных сетях, Разберем основные их виды и особенности использования. Еще будет много подробных примеров и описаний. Для того чтобы лучше понимать что такое вычисления на искусственных нейронных сетях , настоятельно рекомендую прочитать все из категории Практическое применение методов искусственного интеллекта.

Пример решения простейшей абстрактной задачи тут

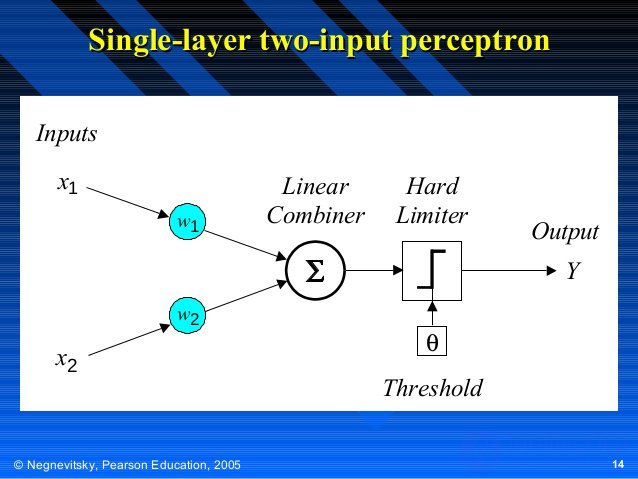

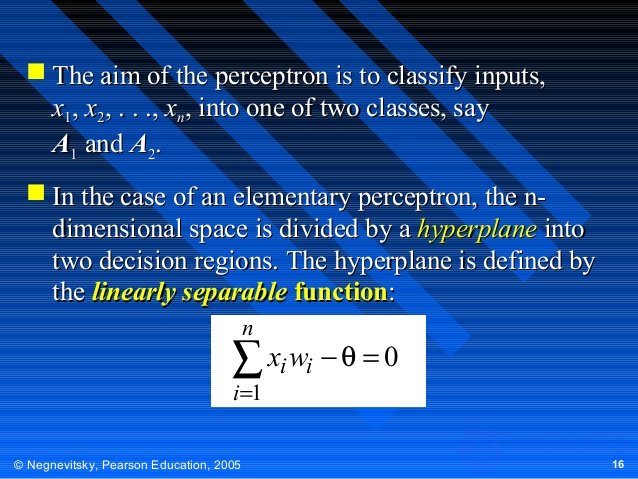

Входные сигналы (переменные) Xi взвешиваются (умножаются на коэффициенты Wi , называемые синаптическими весами), затем суммируются, и полученная взвешенная сумма

S = W1X1+W2X2+…+WNXN

подвергается изменению функцией f(S), называемой функцией активации.

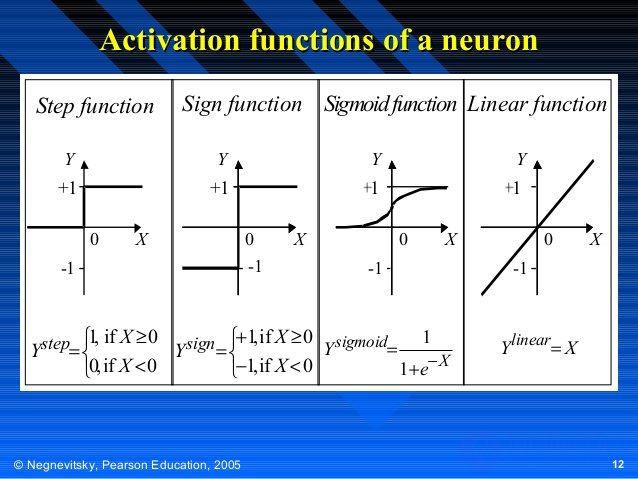

Выходной сигнал Y также может повергаться взвешиванию (масштабированию). В качестве функции активации чаще всего используются

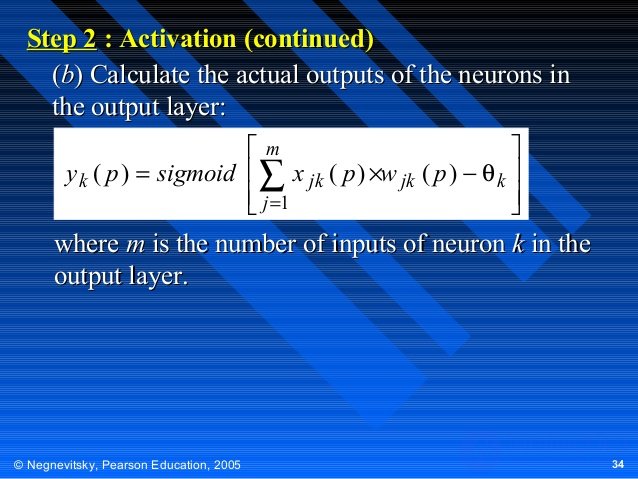

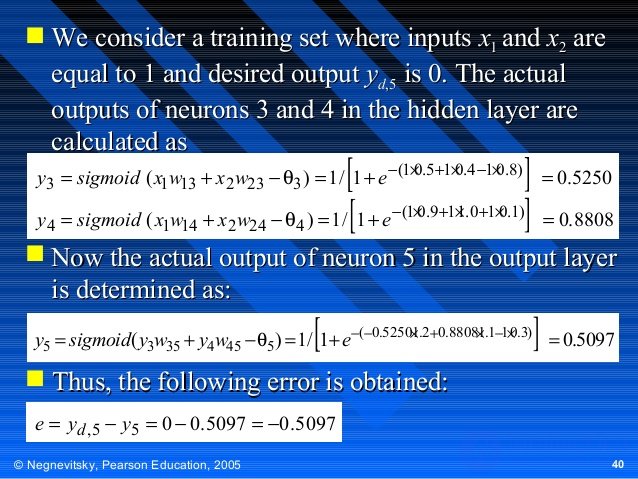

сигмоидная функция Y = 1 / (1 + exp(-λS)), а также гиперболический тангенс, логарифмическая функция, линейная и другие. Основное требование к таким функциям – монотонность.

S = W1X1+W2X2= 0.7x1.5+2.5x-1=1.45

Y = 1 / (1 + exp(-λS))=1/(1+exp(-0.5 1.45 ))=0,326

Функции активации для нейронных сетей

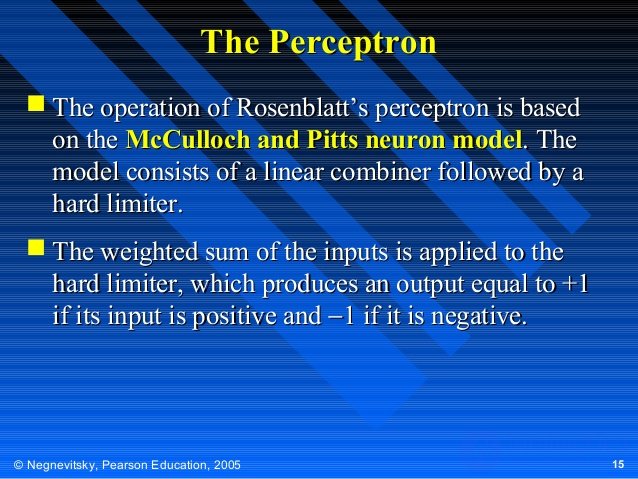

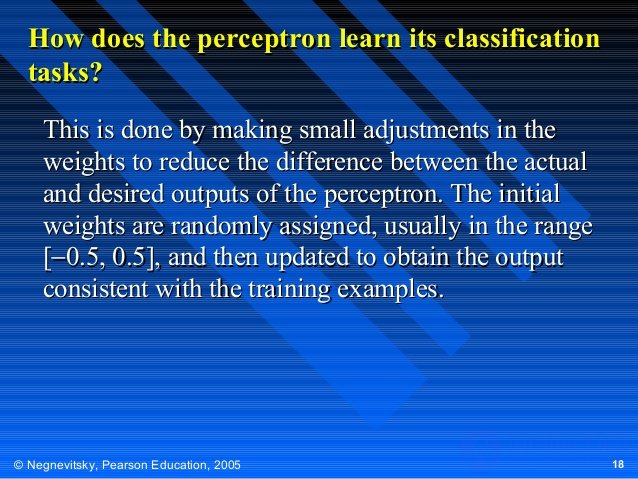

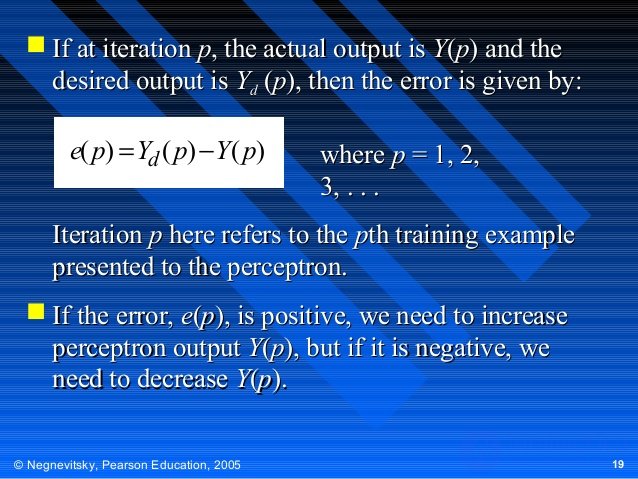

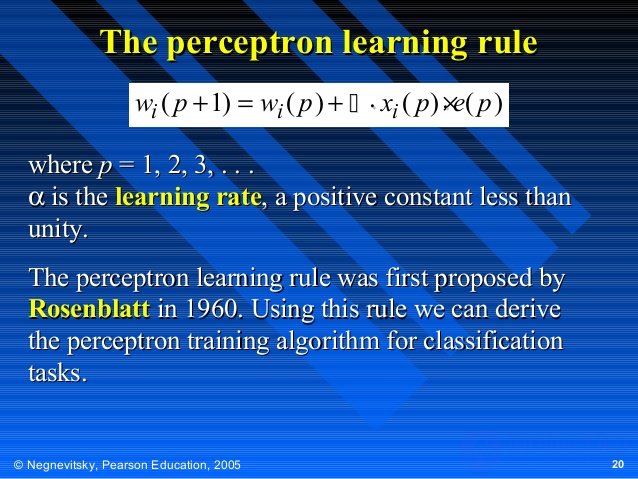

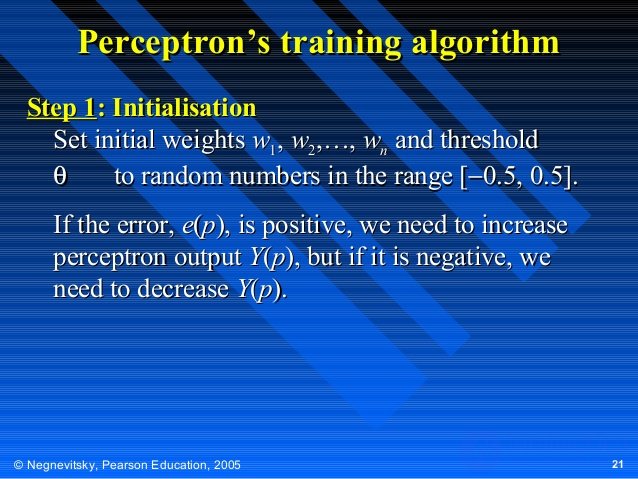

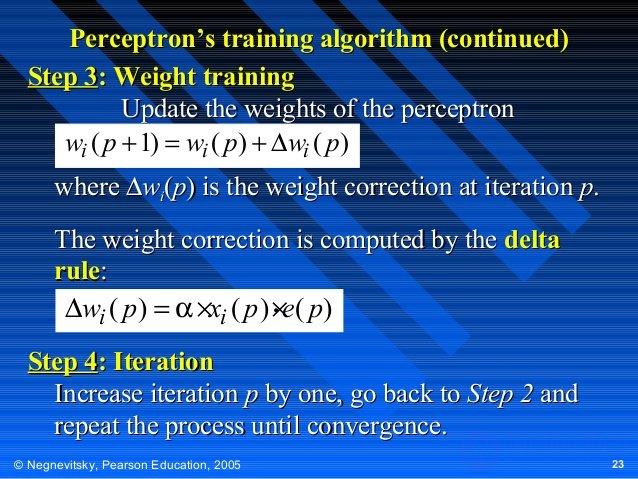

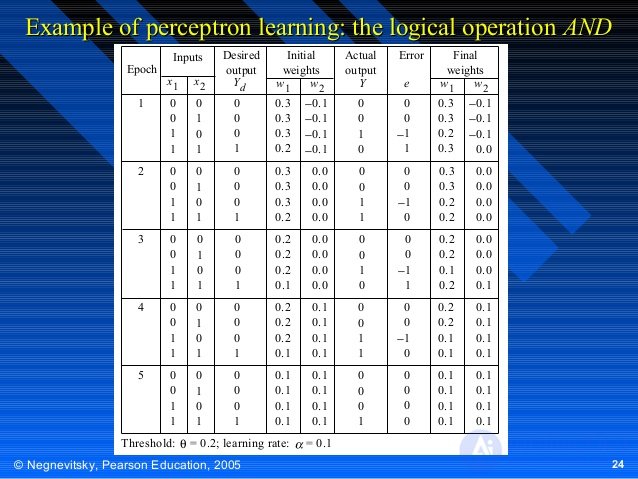

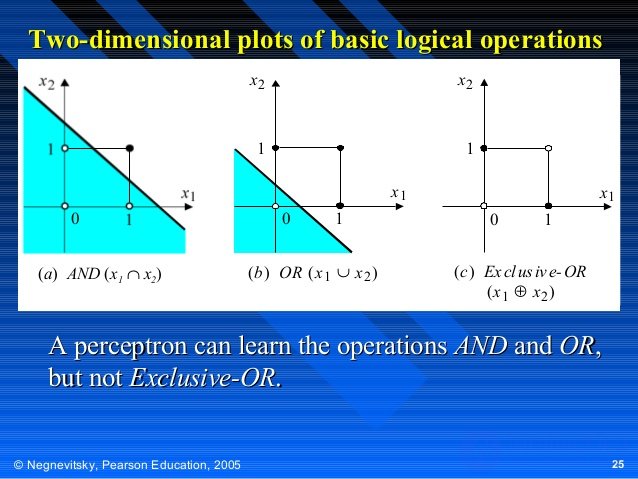

обучение перцептрона

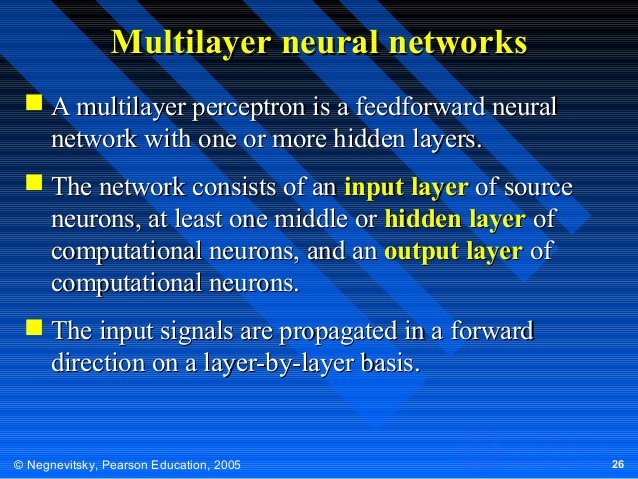

Многослойные нейронные сети

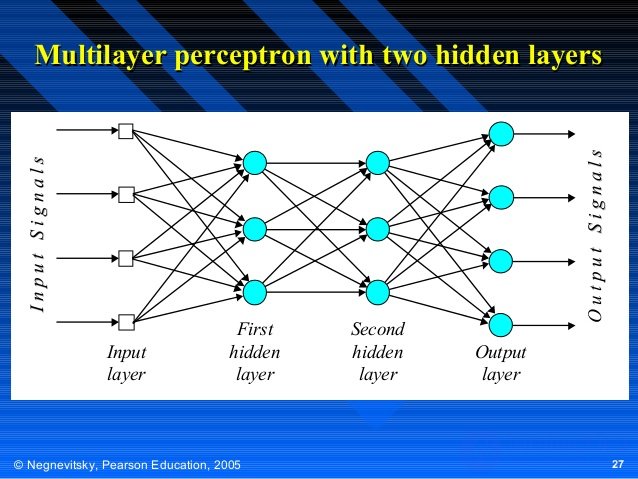

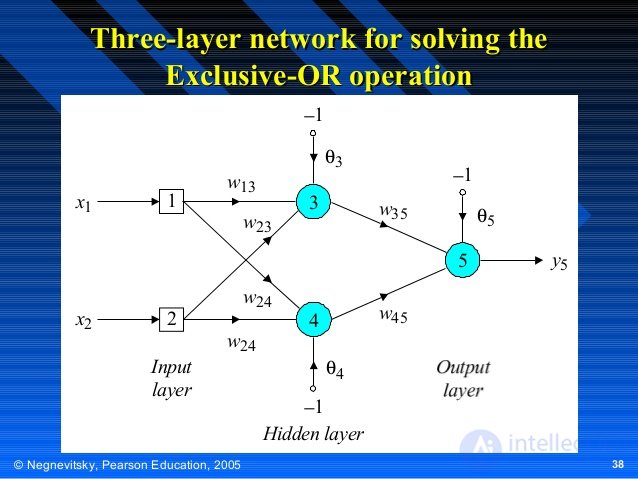

26. Multilayer neural networks A multilayer perceptron is a feedforward neural network with one or more hidden layers. Об этом говорит сайт https://intellect.icu . The network consists of an input layer of source neurons, at least one middle or hidden layer of computational neurons, and an output layer of computational neurons. The input signals are propagated in a forward direction on a layer-by-layer basis.

27. Input Signals Output Signals Multilayer perceptron with two hidden layers Input layer First hidden layer

28. What does the middle layer hide?

A hidden layer “hides” its desired output. Neurons in the hidden layer cannot be observed through the input/output behaviour of the network. There is no obvious way to know what the desired output of the hidden layer should be.

Commercial ANNs incorporate three and sometimes four layers, including one or two hidden layers. Each layer can contain from 10 to 1000 neurons. Experimental neural networks may have five or even six layers, including three or four hidden layers, and utilise millions of neurons.

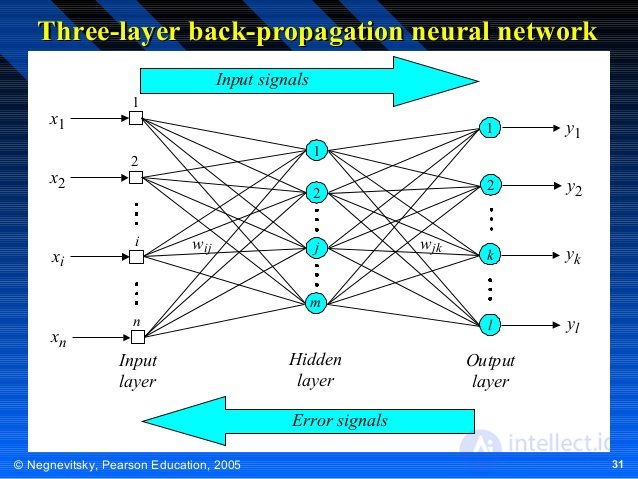

29. Back-propagation neural network

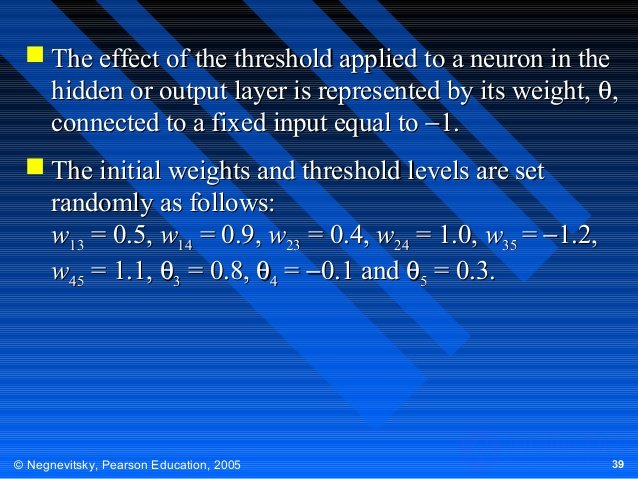

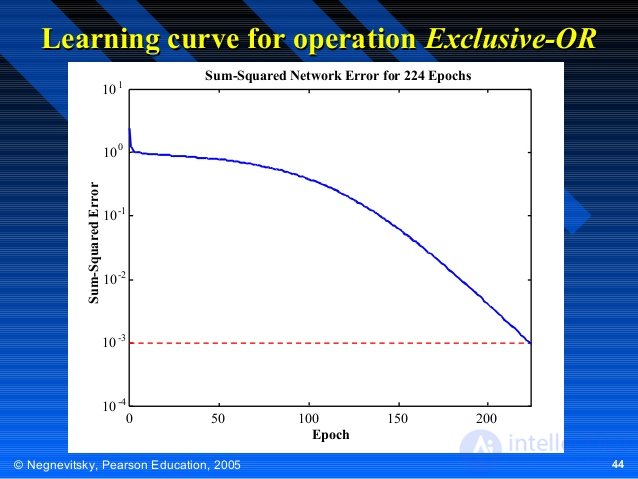

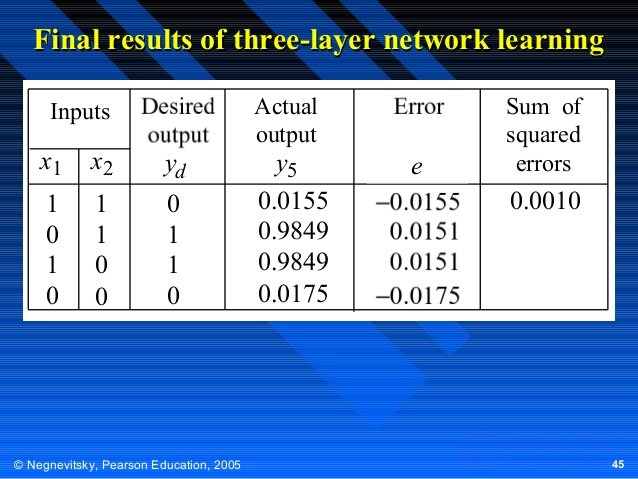

Learning in a multilayer network proceeds the same way as for a perceptron.

A training set of input patterns is presented to the network.

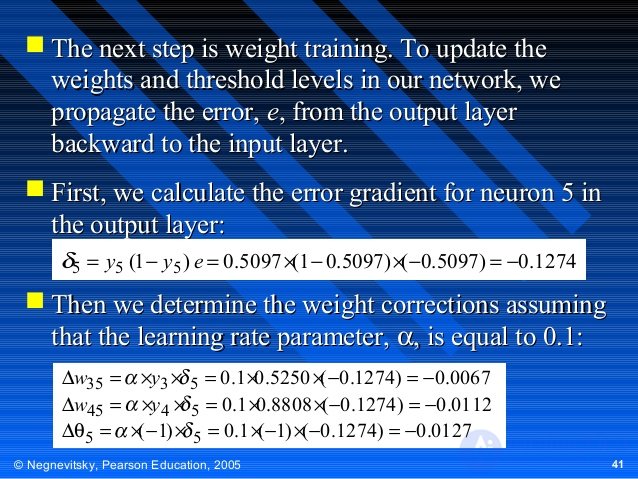

The network computes its output pattern, and if there is an error − or in other words a difference between actual and desired output patterns − the weights are adjusted to reduce this error.

30.

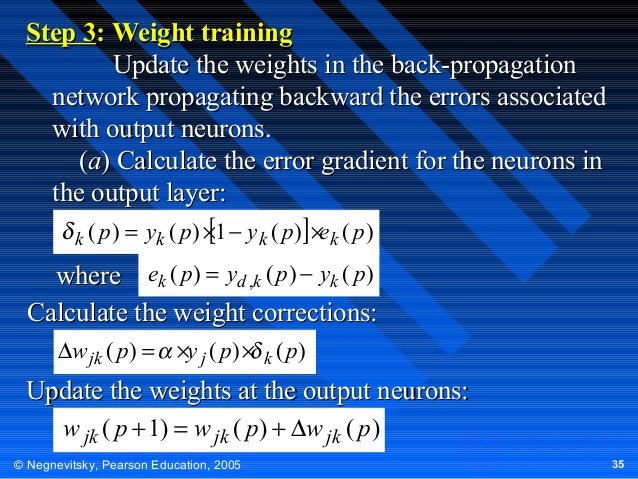

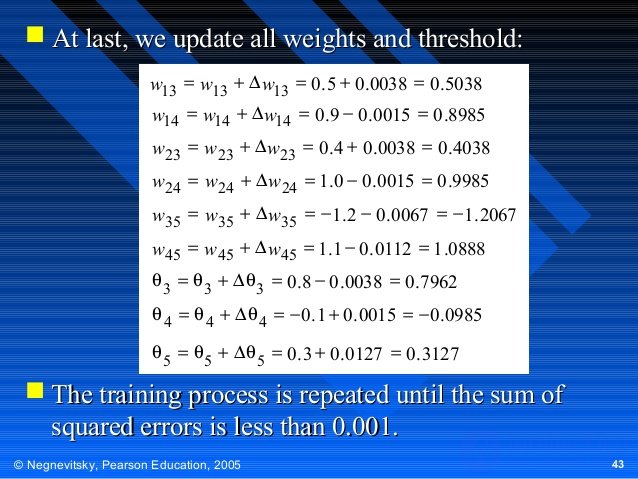

In a back-propagation neural network, the learning algorithm has two phases.

First, a training input pattern is presented to the network input layer. The network propagates the input pattern from layer to layer until the output pattern is generated by the output layer.

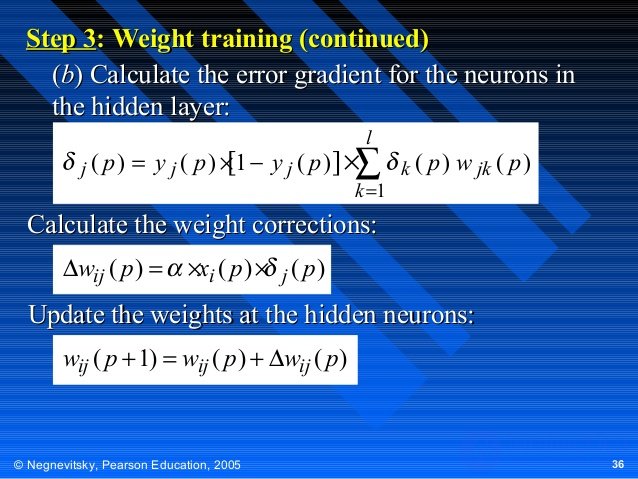

If this pattern is different from the desired output, an error is calculated and then propagated backwards through the network from the output layer to the input layer. The weights are modified as the error is propagated.

В заключение, эта статья об вычисления на искусственных нейронных сетях подчеркивает важность того что вы тут, расширяете ваше сознание, знания, навыки и умения. Надеюсь, что теперь ты понял что такое вычисления на искусственных нейронных сетях и для чего все это нужно, а если не понял, или есть замечания, то не стесняйся, пиши или спрашивай в комментариях, с удовольствием отвечу. Для того чтобы глубже понять настоятельно рекомендую изучить всю информацию из категории Практическое применение методов искусственного интеллекта

Из статьи мы узнали кратко, но содержательно про вычисления на искусственных нейронных сетях

Комментарии

Оставить комментарий

Практическое применение методов искусственного интеллекта

Термины: Практическое применение методов искусственного интеллекта