Лекция

Привет, Вы узнаете о том , что такое информация, Разберем основные их виды и особенности использования. Еще будет много подробных примеров и описаний. Для того чтобы лучше понимать что такое информация, энтропия , настоятельно рекомендую прочитать все из категории Синергетика.

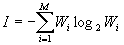

Покажем, что формула Шеннона

(1)

(1)

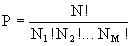

Представим в формуле (1) параметры N! и Ni! Согласно формуле Стирлинга

После преобразований получим

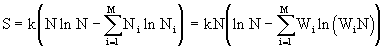

.

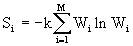

.энтропия на одну молекулу Si = S/N следует из последней формулы

, Wi=Ni/N. Об этом говорит сайт https://intellect.icu . (2)

, Wi=Ni/N. Об этом говорит сайт https://intellect.icu . (2)Рассмотрим, чем вызвано сходство выражений для информации (1) и энтропии (2). Энтропия - мера неупорядоченности, мера недостатка информации в системе. Это видно из следующего примера: при замораживании воды энтропия убывает, но возрастает информация о нахождении молекулы в узлах кристаллической решетки. Но при охлаждении жидкости повышается температура и энтропия холодильника, т. е. второе начало термодинамики выполняется. Из этого следует, что каждый бит информации имеет энтропийную цену. Для перехода от формулы (1) к формуле (2) надо умножить информацию на

В термодинамических единицах бит стоит очень дешево.

Оценим, сколько бит содержится в человеческой культуре. За время существования человечества написано примерно 108 книг, объемом в 25 листов каждая, лист содержит 4*104 знаков. Пусть каждый знак содержит информацию в 5 бит, тогда 108 книг содержат информацию 5*1014 бит, что эквивалентно понижению энтропии на 5*10-9Дж/К.

Изменение энтропии во много раз превышает количество полученной информации. При бросании монеты получается 1 бит информации, но какой величины эта монета и какая мышечная работа затрачивается на бросание, не принимается во внимание. Монета может быть очень маленькой или очень большой (величиной с Монблан), а информация одна и та же. Поэтому приведенная выше оценка содержания книг в единицах Дж/К лишена смысла.

Итак, за получение информации приходится платить повышением энтропии. Минимальная работа  А осуществляется при возникновении флуктуации, но при этом происходит и изменение информации на величину

А осуществляется при возникновении флуктуации, но при этом происходит и изменение информации на величину  I. Показано, что минимальная энергетическая стоимость 1 бита информации определяется зависимостью

I. Показано, что минимальная энергетическая стоимость 1 бита информации определяется зависимостью

.

.Следовательно, минимальная энергетическая стоимость одного бита информации при Т = 300 К, вычисленная по последней формуле равна 2*10-21 Дж/К

Прочтение данной статьи про информация позволяет сделать вывод о значимости данной информации для обеспечения качества и оптимальности процессов. Надеюсь, что теперь ты понял что такое информация, энтропия и для чего все это нужно, а если не понял, или есть замечания, то не стесняйся, пиши или спрашивай в комментариях, с удовольствием отвечу. Для того чтобы глубже понять настоятельно рекомендую изучить всю информацию из категории Синергетика

Из статьи мы узнали кратко, но содержательно про информация

Комментарии